1. Einleitung

Im wissenschaftsnahen Ghosthunting nimmt die Auswertung der Daten (z.B. in Form von Video- oder Audio-Dateien), die während einer PU gewonnen wurden, einen enorm wichtigen Stellenwert ein. Da jeder Mensch (unbewusst) während der Auswertung andere Schwerpunkte setzt und Reize unterschiedlich aufnimmt, bewertet und verarbeitet [1], ist es vor allem in Teams, bei denen sich mehrere Mitglieder an der Datenauswertung beteiligen, essenziell, dass alle nach denselben Gesichtspunkten und denselben Regeln auswerten. Hierzu bietet sich die Verwendung eines einheitlichen Auswertungsformulars an, das die Interpretation der Daten innerhalb gewisser Grenzen ablaufen lässt, also standardisiert.

Zunächst soll deshalb geklärt werden, nach welchen Gütekriterien die wissenschaftliche Auswertung arbeitet, und warum eine standardisierte Datenauswertung im wissenschaftlichen bzw. wissenschaftsnahen Kontext sinnvoll ist. Anschließend findet eine Übertragung dieser Kriterien ins praktische Ghosthunting statt, indem ein vom Team Hidden Voices entwickeltes Auswertungstool beispielhaft vorgestellt wird, bevor die Möglichkeit und die Chancen einer Auswertung über mehrere Untersuchungen hinweg und die Chancen einer Zusammenarbeit mehrerer Teams beleuchtet werden soll. Im Anschluss findet eine kritische Betrachtung über die Grenzen der standardisierten Auswertung im Ghosthunting statt, die auch die Notwenigkeit diskutiert, professionelle Organisationen (z.B. das IGPP oder die GfA) in solch ein Projekt miteinzubeziehen.

2. Wissenschaftliche Gütekriterien

Wie in der Einleitung bereits kurz erwähnt, werden wissenschaftliche Studien entlang bestimmter Gütekriterien entwickelt und auch ausgewertet, die im Verlauf dieses Abschnitts genannt und erklärt werden sollen. Aus diesen Gütekriterien leitet sich die Notwendigkeit einer standardisierten Vorgehensweise ab, die Nachvollziehbarkeit, Wiederholbarkeit, Transparenz aber auch Qualität sicherstellen soll [2]. Nur wer Daten standardisiert erhebt und auswertet, kann auch aussagekräftige Ergebnisse mit einer ernstzunehmenden Reichweite generieren [3].

In der Wissenschaft geht man derzeit von drei Gütekriterien aus: Objektivität, Reliabilität und Validität [4].

Objektivität meint, dass die Messergebnisse unabhängig von der Person sein müssen, die den Versuch durchführt. Beispiel: ein EMF-Meter misst an einer Stelle in der Location dieselben Werte, egal, welche Person das Gerät in der Hand hält.

Die Reliabilität ist ein Kriterium, das die Zuverlässigkeit und somit die Messgenauigkeit untersucht. Misst ein Gerät unter denselben Bedingungen wiederholt dieselben Messwerte, gilt es als reliabel. Beispiel: ein EMF-Meter wird immer dieselben Messwerte zeigen, wenn man es an das Kabel eines sich im Einsatz befindlichen Toasters hält, egal wie oft man den Versuch wiederholt.

Mit der Validität wird beschrieben, ob eine Messung auch gültig ist, also ob überhaupt das gemessen wird, was gemessen werden soll. Beispiel: ein K2-Meter wird immer denselben Ausschlag zeigen, egal ob ein Sendemast oder eine WLAN-Quelle für diesen verantwortlich ist. Es ist unmöglich, nur durch den Ausschlag festzustellen, wie dieser zustande kam. Ein K2-Meter gilt also nicht als valides Messinstrument, wenn man den Ursprung einer EMF-Quelle bestimmen möchte.

Die Beispiele zeigen deutlich, dass die Wahl des richtigen Messinstruments, dessen Einsatz und dessen technische Möglichkeiten die Grundvoraussetzung für das Erheben aussagekräftiger Daten ist. Diese Erkenntnis setzt sich in der Auswertung von Daten fort, die im nächsten Abschnitt anhand eines Beispiels näher erläutert werden soll.

3. Übertragung ins Ghosthunting anhand des HVA

Das Team Hidden Voices stellte Ende 2025 ihr Auswertungssheet vor [5], das auf Grundlage von einer mehrjährigen Entwicklungsarbeit immer wieder angepasst und erweitert wurde. Die Datei wird jedem Team kostenlos zur Verfügung gestellt, die diese nutzen möchte. Das Hidden Voices-Auswertungssheet (= HVA) verfügt über eine Vielzahl von Funktionen und ermöglicht auch dann eine standardisierte Auswertung, wenn mehrere Personen die Daten einer PU (= paranormale Untersuchung) auswerten. Im Folgenden soll der Grundaufbau dieses Sheets dargestellt werden. Auf die genauen Funktionen kann an dieser Stelle im Einzelnen nicht eingegangen werden, da dies den Rahmen dieses Artikels sprengen würde.

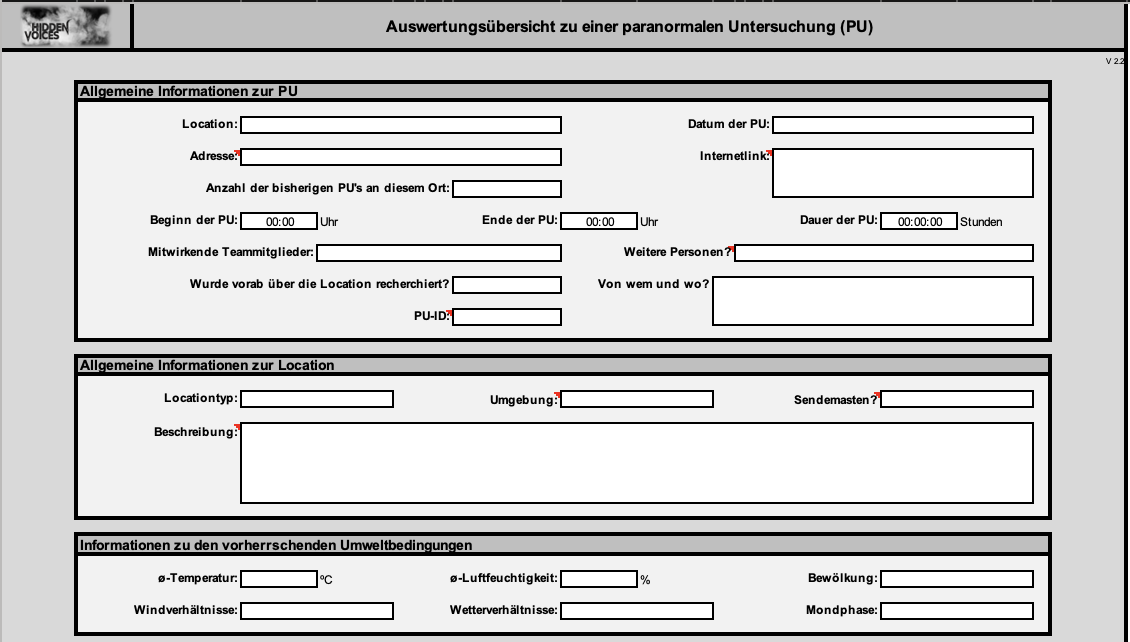

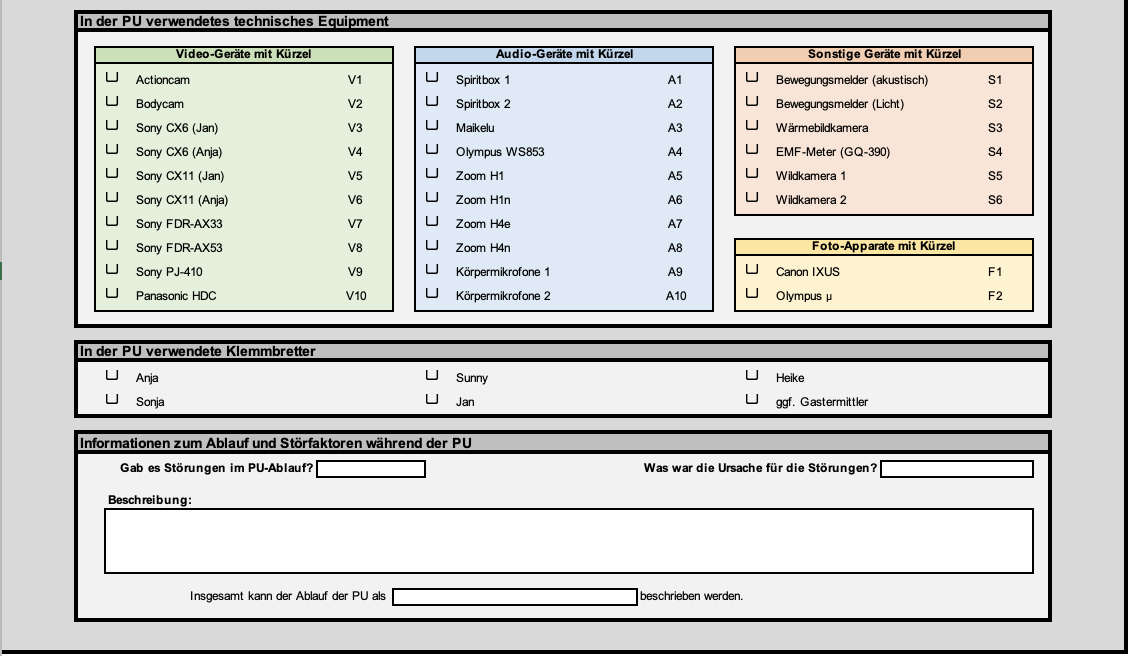

Zunächst sei erwähnt, dass es ein Deckblatt gibt, auf dem zunächst alle allgemeinen Informationen über die PU, die Location, die Umweltbedingungen, das eingesetzte Equipment sowie der eingesetzten Klemmbretter eingetragen werden können. Als letzten Punkt können noch eventuelle Störungen dokumentiert und der Ablauf der PU an sich bewertet werden (siehe Abb. 1 und Abb. 2).

Abbildung 1:

oberer Teil des Deckblatts

Abbildung 2:

unterer Teil des Deckblatts

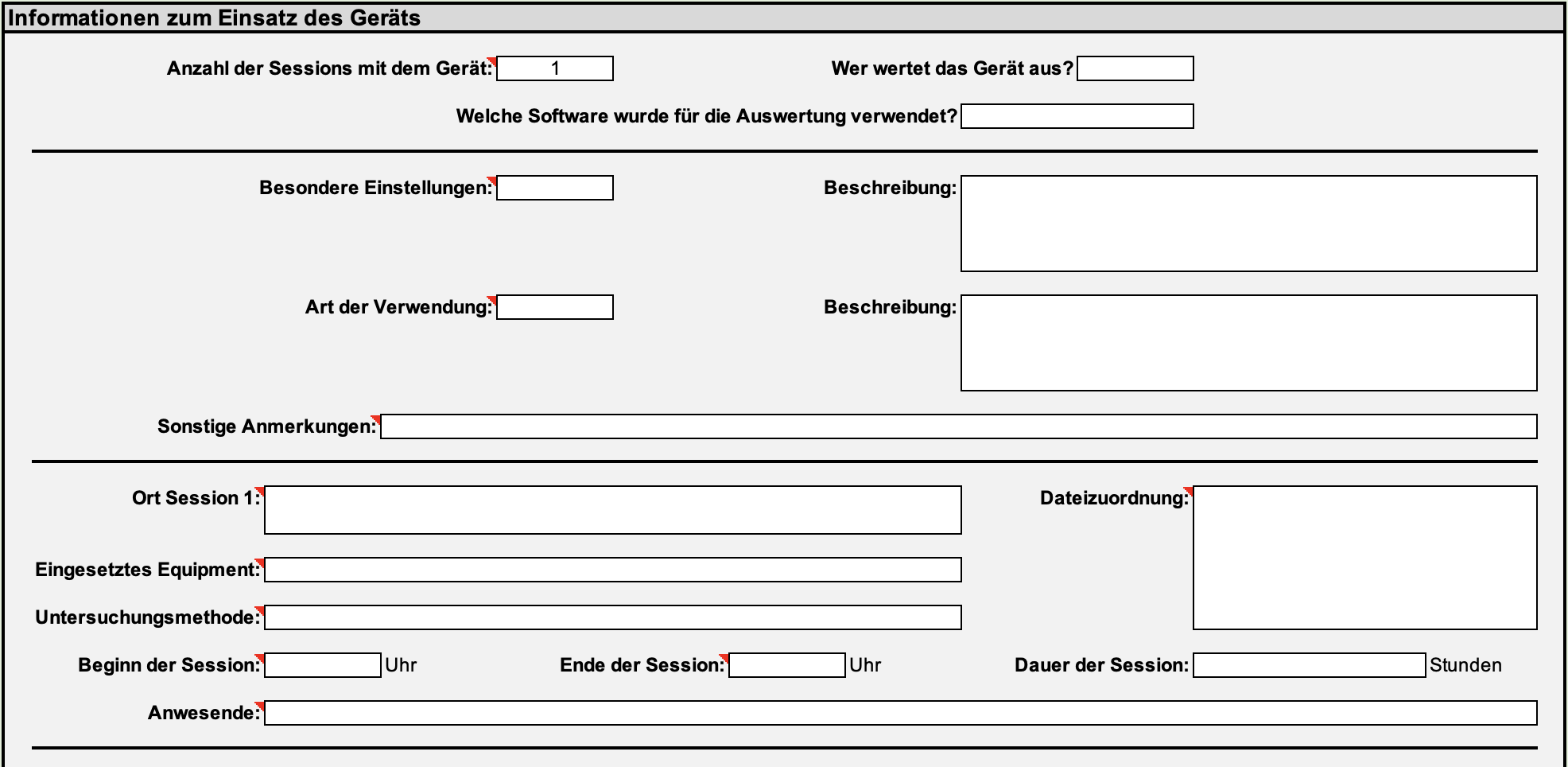

Anschließend gibt es für jedes technische Gerät und jedes Klemmbrett ein eigenes Formular, in denen ebenfalls zunächst allgemeine Informationen zum Einsatz des Geräts (bspw. die Anzahl der Sessions, Art der Verwendung, Orte der Sessions, etc.) dokumentiert werden, was die Nachvollziehbarkeit und Transparenz im Nachgang der PU sicherstellen soll. Auch eine Datei-zu-Session-Zuordnung findet statt, damit eventuelle Anomalien leichter geprüft und mit Aufnahmen auf anderen Geräten verglichen werden können (siehe Abb. 3).

Abbildung 3:

Ausschnitt der Geräte-Informationen

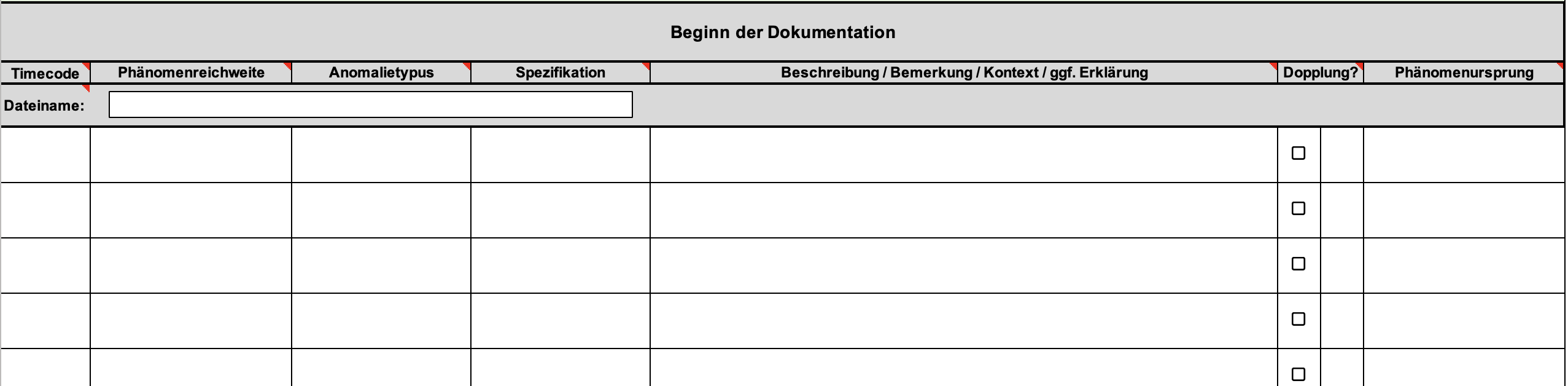

Der untere Kernbereich jedes Auswertungsformulars ist der Dokumentationsbereich, der von Gerätetyp zu Gerätetyp unterschiedlich aussehen kann. Dies hat vor allem den Grund, dass verschiedene Gerätetypen verschiedene technische Voraussetzungen bieten, die sich unter anderem in Dateiformat (z.B. Videodatei oder Bilddatei) und Aufnahmemöglichkeiten (z.B. Video oder statisches Bild) unterscheiden. Dies macht eine differenzierte Auswertung notwendig. Im Folgenden werden nun die unterschiedlichen Arten der Dokumentationsbereiche vor- und gegenübergestellt.

Die Video- und Audiogeräte verfügen über denselben Dokumentationsbereich (siehe Abb. 4), auch obwohl sich die Aufnahmemöglichkeiten von Video- und Audiogeräten unterscheiden. Grund ist der, dass auch auf Audio mündlich festgehaltene (subjektive) Phänomene festgehalten sind, die ebenso dokumentiert werden müssen. Dies kann sowohl visuelle als auch haptische oder olfaktorische Phänomene betreffen. Über allem steht die möglichst lückenlose und nachvollziehbare Dokumentation der einzelnen Phänomene.

Wie auf Abbildung 4 zu sehen, wird zunächst der Timecode der Anomalie abgefragt. Über die im oberen Bereich (Informationen zum Einsatz des Geräts) eingetragene Startuhrzeit kann dann die genaue Uhrzeit des Phänomens ermittelt werden. Die nächsten drei Spalten entsprechen einer deduktiven Einordnung des Phänomens in Phänomenreichweite (subjektiv/objektiv), Anomalietypus (Welcher Sinn wurde angesprochen?) und Spezifikation (Wie kann der Anomalietypus genauer spezifiziert werden?). Es folgt die Möglichkeit der qualitativen Beschreibung der Anomalie, in der auch der Kontext oder bereits eine mögliche Erklärung eingetragen werden kann. Dahinter kann angegeben werden, ob die Anomalie auch noch auf anderen Geräten dokumentiert wurde und es erfolgt über eine Zahl eine Zuordnung. Dies ist wichtig, um nach der Auswertung die Anzahl der dokumentierten Phänomene der Anzahl der tatsächlich aufgetretenen Phänomene gegenüberstellen kann. Am Ende der Zeile kann abschließend eine Vermutung über den Phänomenursprung abgegeben werden, also darüber, ob die Anomalie als natürlich oder paranormal eingestuft wird.

Da die Bewegungsmelder über keinen Datenlogger verfügen, werden diese immer über Audio- bzw. Videogeräten überwacht und auch über diese Formulare ausgewertet. Nur so lassen sich im Nachhinein Rückschlüsse zu den jeweiligen Gegebenheiten ziehen.

Abbildung 4:

Ausschnitt des Dokumentationsbereichs für Video- und Audiogeräte

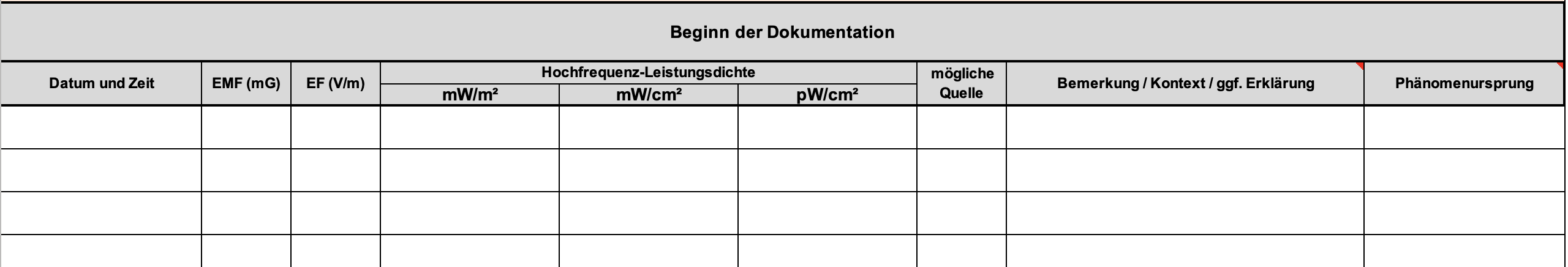

Beim EMF-Meter (hier: GQ-390) werden die relevanten Daten aus der Exportdatei in das Auswertungsformular übernommen und abschließend mit einer Bemerkung und einer Vermutung über den Phänomenursprung versehen (siehe Abb. 5).

Abbildung 5:

Ausschnitt des Dokumentationsbereichs für EMF-Geräte

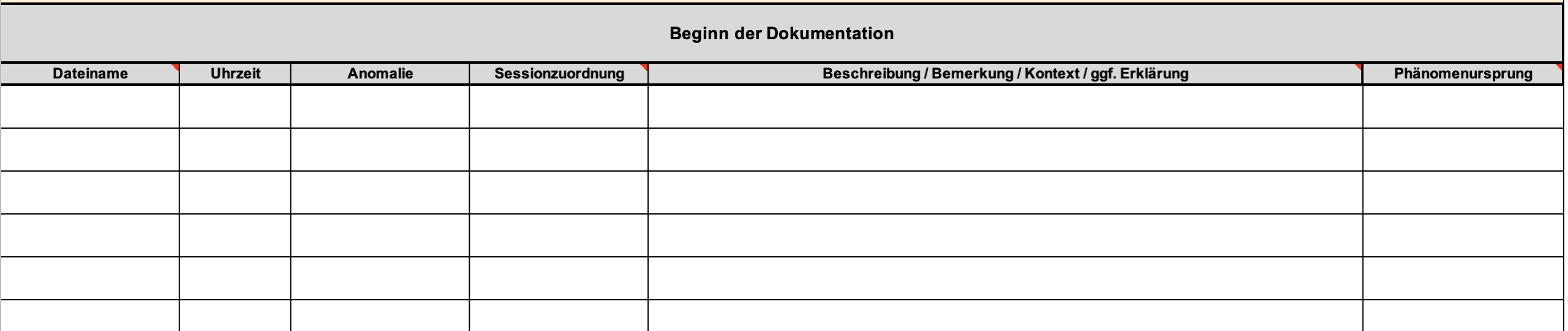

Bei den Fotoapparaten findet, anders als bei den Video- und Audiogeräten, eine Session-zu-Datei-Zuordnung statt (siehe Abb. 6). Dies hat den Grund, dass es erfahrungsgemäß deutlich weniger Dateien mit Anomalien gibt, als dies bei Video- oder Audiogeräten der Fall ist und außerdem eine punktuelle Aufnahme vorliegt, die in einen Kontext gebracht werden muss.

Abbildung 6:

Ausschnitt des Dokumentationsbereichs für Fotoapparate

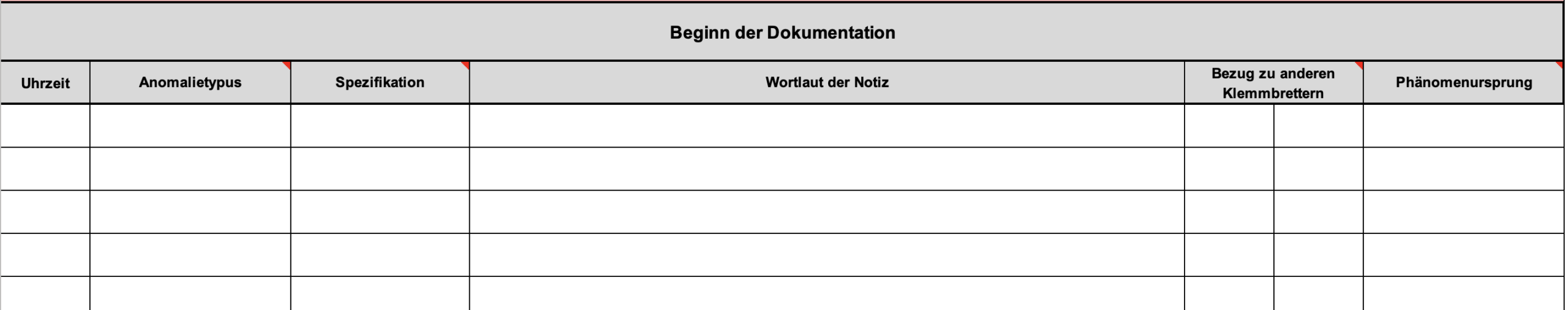

Auch die Klemmbretter machen eine Spezialisierung des Dokumentationsbereichs notwendig (siehe Abb. 7). Hier werden alle handschriftlichen Notizen in das Formular übernommen. Da diese beim Team Hidden Voices für die Dokumentation einer subjektiven Session Verwendung finden, werden hier alle Einträge mit der jeweiligen Uhrzeit versehen, die dann weiter über den Anomalietypus und die jeweilige Spezifikation (siehe oben) genauer beschrieben werden. Es folgt der genaue Wortlaut der Notiz und die Frage nach dem Bezug zu anderen Klemmbrettern (z.B. gab es ein Phänomen, das auch auf einem anderen Klemmbrett beschrieben wurde?). Auch hier steht abschließend die Vermutung über einen möglichen Phänomenursprung.

Abbildung 7:

Ausschnitt des Dokumentationsbereichs für Fotoapparate

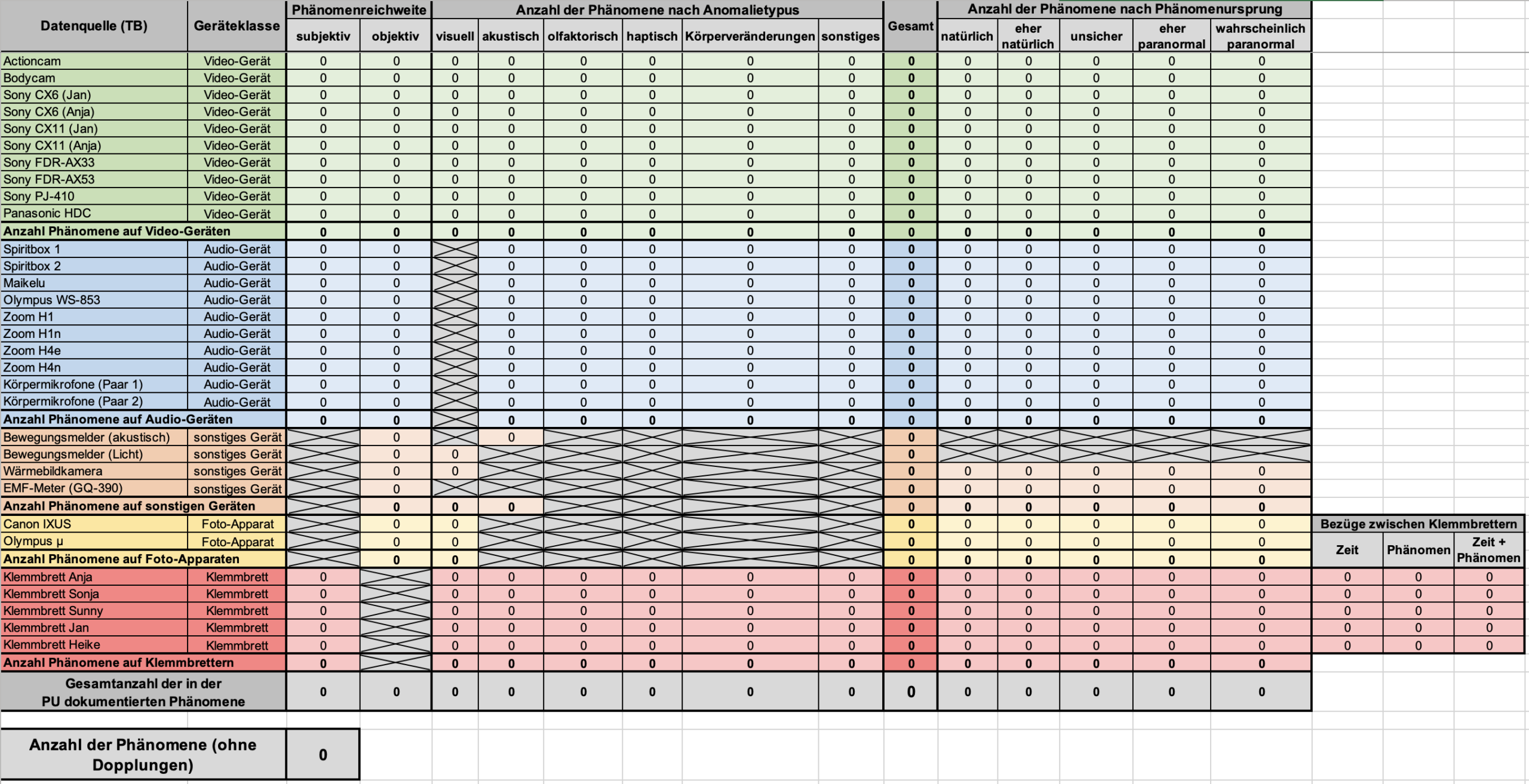

Alle in den Geräte-Formularen eingetragenen Anomalien tauchen schlussendlich in einer Übersicht auf (siehe Abb. 8), in der die Daten für die jeweilige PU quantifiziert dargestellt werden. Es ist also ersichtlich, mit welchem Gerät wie viele Anomalien welchen Typs dokumentiert wurden. Dies ist die Grundlage für eine PU-übergreifende Meta-Analyse, die im nächsten Abschnitt beleuchtet werden wird.

Abbildung 8:

Datenübersicht aus den einzelnen Geräte-Formularen

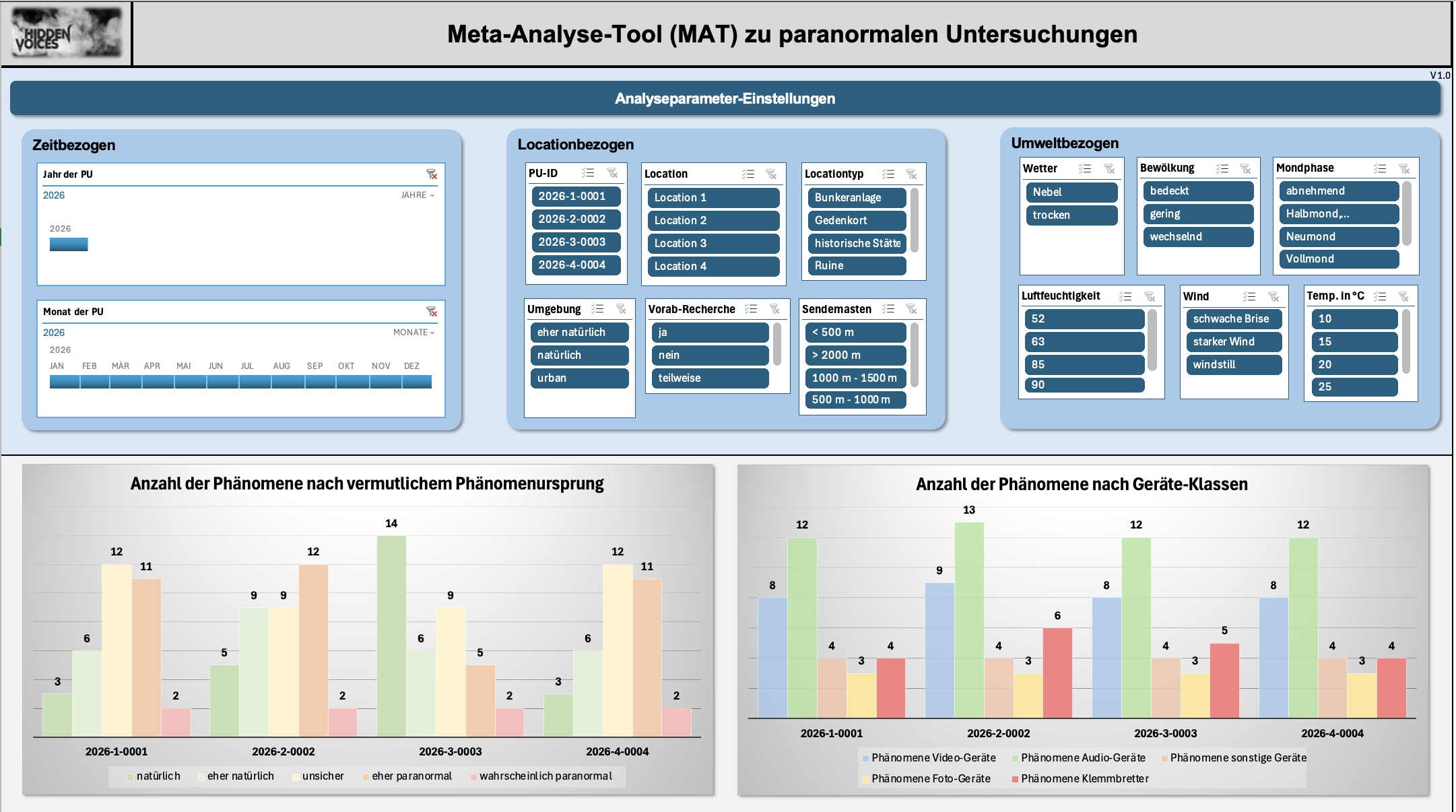

4. Meta-Analyse

Möchte man einigermaßen aussagekräftige Vorher- oder Aussagen über das Zustandekommen von (paranormalen) Phänomenen treffen, darf eine Meta-Analyse der in den einzelnen PUs gewonnen Daten nicht ausbleiben. Auch hierzu hat das Team Hidden Voices bereits ein Meta-Analyse-Tool (MAT) entwickelt, das Daten aus den aus den verschiedenen HVAs abgreift und sowohl grafisch als auch tabellarisch aufbereitet (siehe Abb. 9).

Abbildung 9:

Ausschnitt aus dem Meta-Analyse-Tool (MAT) von Hidden Voices

Hier können alle Parameter wie beispielsweise Wetter, Vorab-Recherche oder bestimmte Zeiträume beliebig miteinander kombiniert werden, um so Rückschlüsse auf das Zustandekommen von Phänomenen ziehen zu können oder die Auftretenswahrscheinlichkeit bestimmter Phänomene vorhersagen zu können. Da das HVA erst im Jahr 2026 den erforderlichen qualitativen Standard erreicht hat, wird eine aussagekräftige Meta-Analyse wohl erst in einigen Jahren zu erwarten sein.

5. Kritische Betrachtung

Bei allem Fortschritt, der bereits in der Zusammenarbeit von Wissenschaft und Laienforschung in Deutschland stattgefunden hat, bleibt es dennoch fraglich, ob es jemals zu einer echten und dauerhaften Kooperation kommen kann. Laienforschung und insbesondere die Feldforschung kann niemals voll und ganz die wissenschaftlichen Gütekriterien Objektivität, Reliabilität und Validität leisten. Dies liegt an der Tatsache, dass im Feld niemals zwei Untersuchungen unter identischen Bedingungen stattfinden können. Es wird immer Faktoren geben, die die Aussagekraft der Ergebnisse aus wissenschaftlicher Sicht schmälern.

Die Arbeitsweise vieler Ghosthunting-Teams wird von der Wissenschaft als eher kritisch betrachtet. Gründe hierfür sind vor allem der Einsatz von sogenannten „Ghosthunter Gadgets“, die objektiv betrachtet keine wissenschaftlich belastbaren Ergebnisse liefern können, aber auch der falsche oder unreflektierte Einsatz von Technik. Rückmeldungen werden in der Auswertung außerdem meist wenig hinterfragt bzw. in den Dokumentationen als fragwürdig eingestuft. Dies führt dazu, dass die Wissenschaft keine verlässlichen Erkenntnisse aus den Daten von Ghosthuntern ableiten kann [6].

Das letzte, aber nicht minder gewichtige Problem ist das der (noch) kargen Datenlage. Möchte man verlässliche Aussagen über das Zustandekommen und die Auftretenswahrscheinlichkeit bestimmter Phänomene treffen, sollten hierfür mehrere Hundert Datensätze zu jedem Parameter vorliegen (= Grundgesamtheit). Je weniger Daten vorhanden sind – also je geringer die Grundgesamtheit ist, desto geringer ist die Aussagekraft und die wissenschaftliche Verwertbarkeit der Ergebnisse. Es bräuchte also eine breite Zusammenarbeit mehrerer Ghosthunting-Teams, die sich dem wissenschaftsnahen Ghosthunting verschrieben haben.

6. Chancen standardisierter Auswertung

So aufwändig diese Vorgehensweise bei der Auswertung ist und so kritisch man diese (noch) betrachten muss, so wertvoll kann diese jedoch auch sein. Schließlich sollte es das Ziel eines jeden Ghosthunting-Teams sein, belastbare und nachvollziehbare Daten zu schaffen, die auch in professionellen, wissenschaftlichen Kreisen zur Aufklärung von paranormalen Phänomenen beitragen kann. Denn eines geht aus mehreren wissenschaftlichen Studien zu RSPK hervor: lange nicht alle RSPK-Fälle sind auf eine Fokusperson zurückzuführen. Die Prozentsätze schwanken hier zwischen 38% und 80% [7], [8], [9]. Insofern sollte der animistische Erklärungsansatz (Stand 2026) nicht als alleinige Ursache für Spukphänomene vorausgesetzt werden – abgesehen von diversen Berichten über ortsgebundenen Spuk, der per Definition nicht mit einer Fokusperson in Verbindung gebracht wird.

Diese Argumente drängen auf ein gemeinsames und standardisiertes Vorgehen mehrerer, bestenfalls aller Ghosthunting-Teams, die sich über Vorgehen, verwendete Geräte und Auswertung bestimmte Gütekriterien geschaffen haben und eine sinnvolle Zusammenarbeit zwischen Wissenschaft und Laienforschung ermöglichen.

7. Quellen

Dieser Beitrag wurde am 07.02.2026 zuletzt bearbeitet.